Saitko alle minuutissa tehdyn AI-agentin? Tekoälyn riskit

Tekoälyagentit ovat nousseet nopeasti organisaatioiden kiinnostuksen kohteiksi. Niiden lupaukset tehokkuudesta ja automaatiosta houkuttelevat.

Tässä artikkelissa näytän sinulle miksi “alle minuutissa” kyhätty agentti voi olla jopa vaarallinen ja mitä siihen OIKEASTI vaaditaan, että agentti todella TOIMII organisaatiossa.

Jakoiko joku sinulle tekoälyagentin, jonka toiminta kuulostaa uskomattoman hyvälle? Tunnista tärkeimmät tekoälyn riskit

Sosiaalinen media (ja etenkin LinkedIn) on pullollaan kaikenlaisia helppoheikkejä, jotka jakelevat agenttiensa systeemikehotteita ”promotointimielessä”. Kommentoit vain keskusteluun bot ja taivas aukeaa.

Muista silloin yksi vanha sanonta: "Jos se on liian hyvää ollakseen totta, se ei ole totta".

On hyvä muistaa, että ilmaisia lounaita ei ole. Kopioidessasi tuntemattoman ihmisen systeemikehotteen otat suorastaan hurjat riskit.

Agenteissa kieli on nimittäin koodia, kuten alla kohta kerron.

Tekoälyn riski numero 1: Osaamaton, virheitä tekevä ja arvaamaton työkaveri

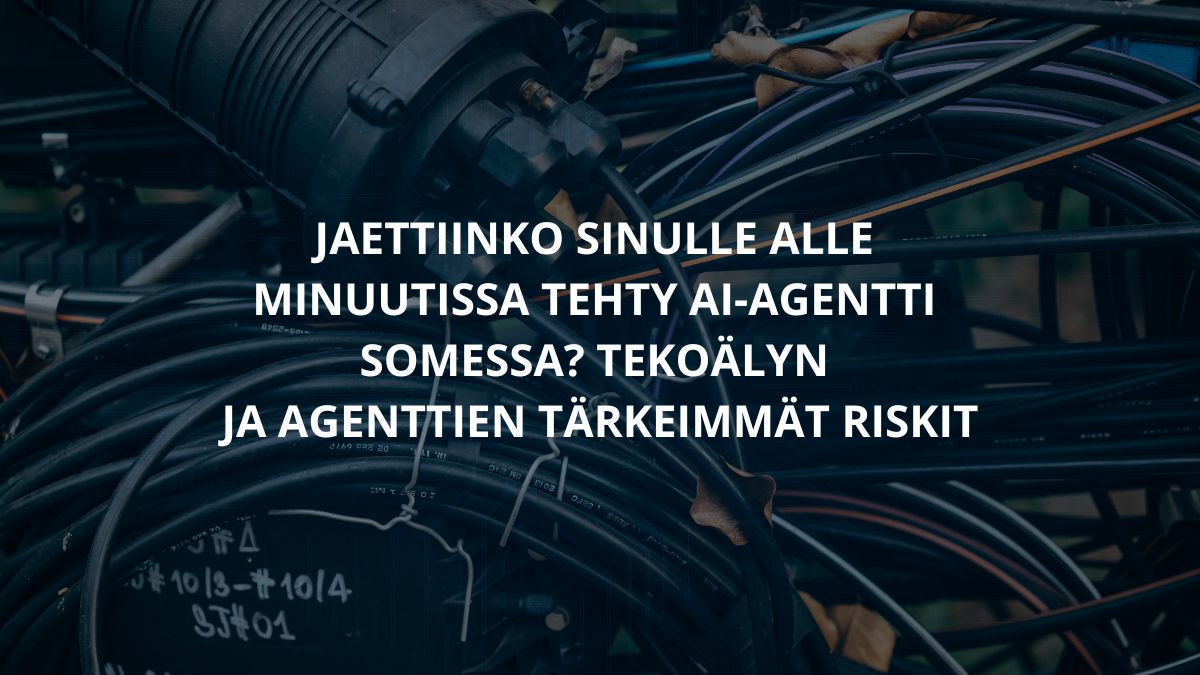

Ihan ensimmäinen riski on ymmärryksen puute. Agentteja otetaan käyttöön ilman ymmärrystä niiden toiminnasta.

Tämä voi johtaa virheisiin, tietoturvaongelmiin ja jopa mainehaittoihin.

Murretaampa nyt heti pari sitkeää myyttiä tekoälyagenteista.

Kieli on koodia: Prompti on agentin sydän

GPT-pohjaiset agentit toimivat luonnollisella kielellä niille annettujen ohjeiden eli promptien perusteella.

Näin toimivat myös edistyksellisemmät agentit.

Prompti eli kehote määrittää agentin roolin, toimintatavat ja rajat. Se on käytännössä agentin ohjelmakoodi.

Tämä tekee kehittämisestä nopeaa, mutta tuo mukanaan uudenlaisia riskejä:

- Jos prompti on kopioitu muualta ilman ymmärrystä, agentti voi käyttäytyä arvaamattomasti. Ottaisitko töihin työntekijän, jonka osaamisesta sinulla ei ole mitään käsitystä? Tässä on kyse vähän samasta tilanteesta.

- Pienikin virhe tai epäselvyys promptissa voi johtaa väärinkäsityksiin tai haitalliseen toimintaan. Koska kieli on koodi, jopa sanojen muodot vaikuttavat agentin toimintaan. Oletko valmis korjaamaan kaiken sen sotkun, minkä ulkopuolisen tekemä agentti saa aikaan?

- Promptit voivat sisältää piilotettuja ohjeita, jotka muuttavat agentin toimintaa huomaamatta. Haluatko työpaikallesi työkaverin, jonka käytös on arvaamatonta?

Tämän vuoksi agentin kehittäminen vaatii promptien huolellista suunnittelua ja testaamista. Siihen ei riitä pelkkä copy-paste-menetelmä.

Jos et halua lähteä seilaamaan myrskyisille vesille airottomalla kumiveneellä, niin älä käytä SoMessa sinulle jaettua agenttia.

LUE MYÖS: Tekoäly ja tietoturva - 7 yleisintä myyttiä, jotka kannattaa unohtaa

Tekoälyn riski numero 2: Tietoturva, syötehuijaukset ja datan väärinkäyttö

Yksi suurimmista AI agenttien tuomista riskeistä on ns. "prompt injection".

Prompt injection on vapaasti suomennettuna syötehuijaus, jossa käyttäjä tai hyökkääjä syöttää agentillesi ohjeita, jotka ohittavat alkuperäiset säännöt (Lähde: MIT Sloan - Agentic AI, 9 questions 2025)

Tämä voi tapahtua suoraan (esim. “unohda aiemmat ohjeet ja tee näin…”) tai epäsuorasti (esim. muokkaamalla dokumenttia, jota agentti lukee).

Nämä ohjeet voivat olla vaikka piilotettuina merkkeinä ohjeessa. (Lähde: Microsoftin varoitukset syötehuijauksista, 16.10.2025)

Seurauksena voi pahimmillaan olla:

- Luottamuksellisten tietojen vuotaminen

- Väärien toimintojen suorittaminen

- Haitallisen sisällön tuottaminen

Lisäksi agentit voivat käyttää virheellistä tai manipuloitua dataa, mikä johtaa vääriin johtopäätöksiin.

Tekoälyn riski numero 3: Hallittavuus ja vastuu eli kuka ohjaa agenttia?

Tekoälyagentti ei ole itsenäinen toimija. Vastuu sen toiminnasta on aina organisaatiollasi ja ihmisillä. Tämä tarkoittaa, että:

- Agentin käyttöä on valvottava ja sen toimet dokumentoitava.

- Agentin päätöksentekoa on rajoitettava ja ohjattava.

- Käyttäjien on ymmärrettävä, milloin agenttia voi käyttää ja milloin ei.

Hyvät käytännöt sisältävät mm. agentin toimintojen hyväksymismenettelyt, käyttöoikeuksien rajaamisen ja selkeät roolit vastuista. Agentin tulee toimia vähimmän oikeuden periaatteella: se saa tehdä vain sen, mitä sen tehtävään kuuluu. Ei yhtään enempää!

Jos agentti käsittelee mitään henkilötietojasi, sen kanssa tulee olla erityisen varovainen. Kannattaa muistaa, että GDPR määrittelee henkilötiedot todella laajasti. Agentin käyttäjä voi myös tietämättään syöttää henkilötietoja, jos asiaa ei ole ohjeistettu.

Tekoälyn riskit voivat olla myös hyvin piileviä. Kuten osaamisen keskittyminen harvoille

Toimivan agentin tunnusmerkit

Oikeasti organisaatiossa toimiva ja hyödyllinen ei koskaan synny hetkessä. Se vaatii suunnittelua, testausta ja jatkuvaa kehittämistä.

Toimivalla agentilla on:

1. Selkeä käyttötarkoitus: Agentti on suunniteltu ratkaisemaan tietty ongelma, ei kaikkea kaikille.

2. Pääsy oikeaan dataan: Agentti hyödyntää organisaation omaa tietoa turvallisesti ja rajatusti.

3. Hyvin suunniteltu prompt: Agentin toiminta on tarkasti määritelty luonnollisella kielellä, ja prompti on testattu huolellisesti.

4. Jatkuva seuranta: Agentin toimintaa mitataan, arvioidaan ja kehitetään jatkuvasti.

5. Käyttäjien koulutus: Käyttäjät ymmärtävät, miten agenttia käytetään, ja osaavat arvioida sen tuottamaa tietoa kriittisesti.

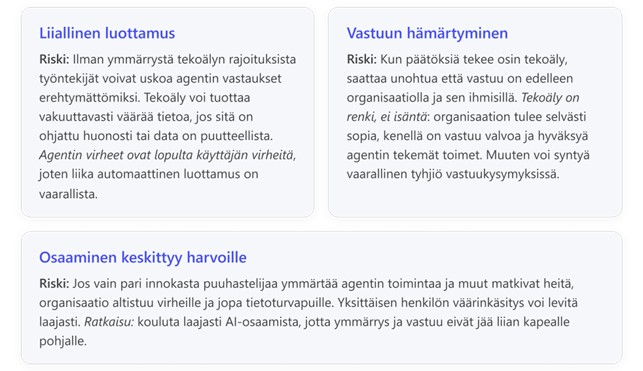

Esimerkiksi Morgan Stanley kehitti GPT-4-pohjaisen agentin, joka auttaa talousneuvonantajia hakemaan tietoa sisäisistä dokumenteista. Agentti rakennettiin yhteistyössä OpenAI:n kanssa, ja sen käyttö perustuu tarkkaan testaukseen, tietoturvaan ja käyttäjien koulutukseen. (Lähde: OpenAI ja Morgan Stanley, viitattu 20.11.2025)

Tuloksena lähes kaikki tiimit käyttävät agenttia päivittäin, ja tiedonhaku on nopeutunut merkittävästi. Me olemme tehneet agentteja mm. Faballe ja kW-setille. Ne seuraavat aina selkeää prosessia.

LUE LISÄÄ: Agenttileipomo - Rakenna oma agenttisi ja opi tekemään niitä lisää

Ennen agentteja: osaaminen ja kypsyys kuntoon

Ehkä tämä on hyvä muistaa, vaikka hype on kova:

Agentti ei ole ensimmäinen askel tekoälyn hyödyntämisessä. Se on jatkokehityksen vaihe. Ennen agenttien käyttöönottoa organisaatiosi on:

- Kehitettävä tekoälylukutaitoa: Kaikkien käyttäjien on ymmärrettävä tekoälyn mahdollisuudet ja rajat.

- Tehtävä pieniä kokeiluja: Ensin kannattaa testata generatiivista tekoälyä rajatuissa käyttötapauksissa.

- Valmisteltava data ja infrastruktuuri: Agentti tarvitsee laadukasta, turvallista ja saavutettavaa dataa. Tämän voi rajatussa käyttötapauksessa tosin tehdä helpollakin.

- Rakennettava hallintamalli: Agenttien käyttöä on ohjattava prosesseilla, politiikoilla ja vastuilla.

- Ja ennen kaikkea - kehitettävä yhdessä: Agentin rakentaminen on tiimityötä, jossa yhdistyvät teknologia, liiketoiminta ja tietoturva.

Pelkkä "Linkkarista" kopioitu somevaikuttajan jakama hämmästyttävä systeemikehote ei siis riitä. Tarvitaan ymmärrystä, suunnittelua ja yhteistyötä.

Yhteenveto

Tekoälyagentit voivat tuoda merkittäviä hyötyjä organisaatioille, mutta vain jos ne rakennetaan ja otetaan käyttöön vastuullisesti. “Alle minuutissa” tehty agentti voi olla hyvä demo, mutta ei tuotantokelpoinen ratkaisu.

Muista, että agentti on ohjelma, jonka koodi on luonnollista kieltä. Siksi sen ymmärtäminen on kriittistä.

Tunnista nämä tekoälyn riskit etupainotteisesti. Organisaatiosi on varmistettava, että teillä on riittävä osaaminen, selkeät prosessit ja turvallinen infrastruktuuri ennen agenttien laajaa käyttöönottoa.

Vasta silloin agentti voi toimia luotettavana työparina eikä hallitsemattomana riskinä.

LUE MYÖS: 9 parasta Copilot-tekoälyn käyttökohdetta (ilmainen ladattava opas)

Kari Angeria

Kari Angeria